前几日参加 DevFest会议的时候,提到了有个提供每周30小时免费算力的Kaggle,有两个朋友问到了,今天就大概讲下。

打开kaggle.com网页如下图,

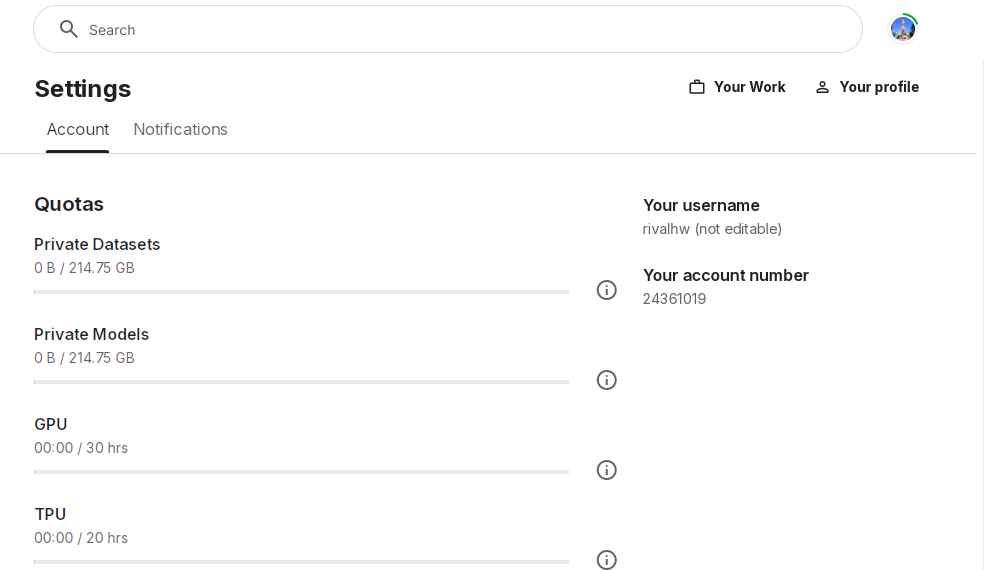

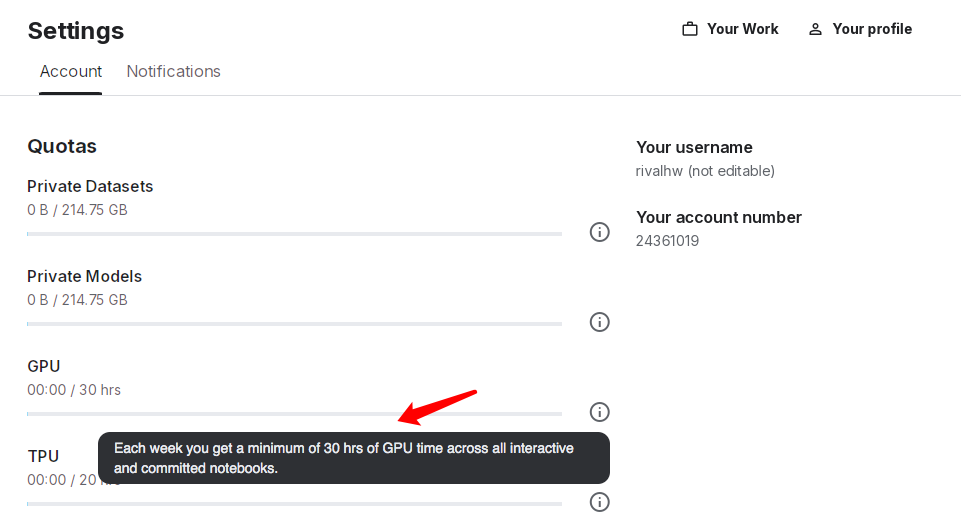

kaggle上又提供每周30小时免费算力,里边的介绍可以看到,如下图,

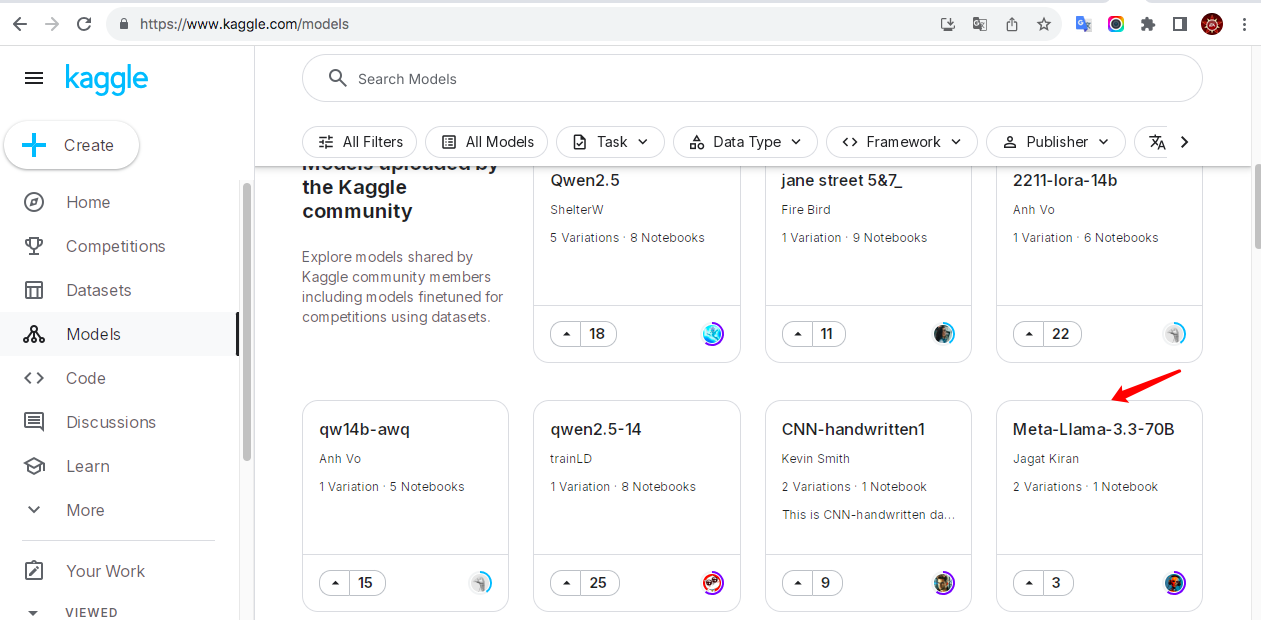

对于AI感兴趣,想微调训练自己的大模型的同学都知道,GPU在当下是非常紧俏,很多时候想要微调(Fine-tune)大模型,甚至想要跑下大模型,苦于自己电脑的配置不够,只好“望洋兴叹”,比如前阵子Meta出了Llama-3.3-70B,我的电脑显卡达不到这个配置,下载下来也无法使用,而kaggle上就可以在上边使用这款大模型,

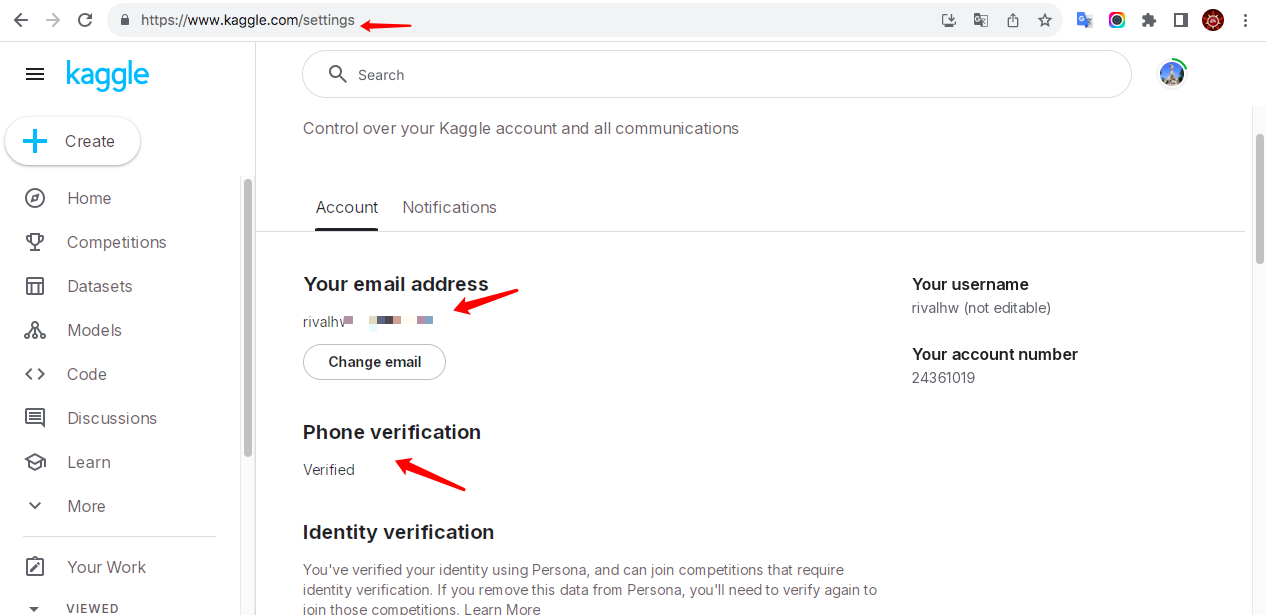

想要在kaggle上使用免费资源,有以下两点必须得注意,否则无法使用,如下图,

简单说,就是邮件需要验证,电话也需要同时验证,两者必须同时满足。

嗯,用国内的手机号码就可以。

但是,我自己在注册验证时,发现死活无法收到验证码,后来问了下别人,发现将区域所在地改为 台湾 地区,就可以收到验证了。

貌似大陆和香港区域都不可以,无法进行下一步。

有朋友说自己使用google的codeLab,听人讲,kaggle貌似也是跟google合作的,得到了google的大力支持,双方不定期还有些合作。

无论哪一个,在这个AI大势所趋,算力如此紧张之下,能有个为我们免费提供GPU等算力资源的地方,怎么说来都是一件方便自己的好事情。

哈哈 又来大伟哥 这里看了个新奇的东西~😀

欢迎😀😀

居然还可以这么玩,我什么时候看看也去申请一下

不过呢,没算力去autodl租,现在也算便宜4090d大概2块一个小时,A800(80G)大概6-7块一个小时。

前天我和朋友在讨论,准备微调一个LLM模型来做专项任务,大概算了一下,一天大概1200的成本。

确实烧钱呢

但是呢,我们现在连像样的数据集都没有,哈哈哈

估计拼到后边,数据集才是最稀缺的,因为其它的都可以用钱买到,但数据集可不一定

弄数据集对一般人来说,其实目前也有偷懒办法,也就是微调羊驼那个办法。

先收集一堆文档(其实羊驼那连这个都没收集,直接开问)、然后调用GPT或者deepseek之类模型的API,把文档喂给这些成型的大模型,让它们输出[{q:..},{a:...}],这种问答格式,然后微调自己的模型。不过如何测试与评估,微调效果。这个我没真想好办法了。

感觉挺高级的😇

😇😇

元旦快乐,大伟哥

感谢您分享的文章,先码住或许未来能用到。

元旦快乐,@love5200 虽然晚了点 但保持心情愉快可不分早晚哦

大伟哥这个那么高阶的都会玩,我先收藏起来,家里显卡试一下能不能带动

我的电脑显卡是带不动Llama-3.3-70B

让他预测HIVE价格

LLM大模型的原理是只能推测,没法预测呀